¿Máquinas con ética? Cómo enseñar moral a los ordenadores al traducir deontología a números

En pleno debate sobre los riesgos de la inteligencia artificial, se buscan fórmulas para que estos sistemas prioricen unas decisiones sobre otras en función de técnicas como el aprendizaje por refuerzo

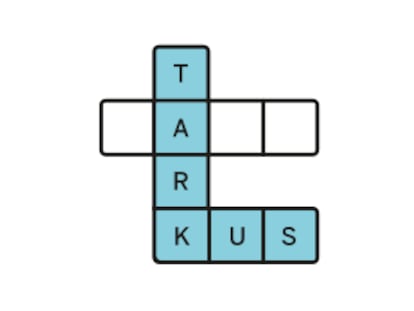

Hay tres elementos básicos en la fórmula matemática para enseñar un código deontológico a las máquinas. Y no se diferencia mucho del cóctel ético que manejamos las personas. Acción, valor y norma conforman esta tríada con la que juegan los investigadores para establecer limitaciones que controlen el comportamiento de las inteligencias artificiales.

Para las personas, el valor equivale a una especie de norma social, comúnmente aceptada: sabemos que mentir es una acción moralmente reprobable. Y las normas ayudan a formalizar la idea de valor en un código jurídico. “Las normas prohíben, como se prohíbe fumar en espacios cerrados, pero el valor también te ayuda a promover acciones buenas, como por ejemplo hacer un donativo o ser amables”, expone Maite López-Sánchez, investigadora en IA y catedrática de la Universitat de Barcelona, que trabaja en sistemas para introducir principios éticos en sistemas de inteligencia artificial.

Las personas aprendemos este marco, que sirve para delimitar nuestro comportamiento, durante el proceso de socialización. Pero en las máquinas hay que traducir todo a números y funciones matemáticas. El objetivo final es proporcionar una ordenación de las acciones. “Al final las máquinas están muy integradas en la sociedad y acaban tomando decisiones que nos afectan a las personas. Sería deseable que estas decisiones estuvieran alineadas con lo que nosotros entendemos que es correcto, que se integraran bien socialmente”, sostiene la investigadora.

López-Sánchez acude a lo más básico para explicar la necesidad de tener máquinas con ética: “Puedo tener un coche autónomo y, si le doy el objetivo de llevarme al trabajo, el coche haría la ruta que fuera más eficiente o más rápida. Nosotros tenemos muy claro que quiero llegar a mi trabajo, pero no quiero atropellar a nadie. No sería moralmente correcto”. Pero la casuística va mucho más allá de los supuestos extremos. “Hay muchos aspectos a tener en cuenta para conducir correctamente. No se trata solo de no saltarte las normas, sino de hacer bien las cosas, como ceder el paso a un peatón, mantener una distancia de seguridad o no ser agresivo con el claxon”, añade la investigadora.

La ética en las inteligencias artificiales también sirve promover un tratamiento igualitario. “Si es un sistema de toma de decisión para conceder un seguro médico, lo que queremos es que sea un algoritmo que no tenga sesgo, que trate de la misma manera a todas las personas que evalúe”, apunta López-Sánchez.

En los últimos años, han saltado a la palestra sesgos algorítmicos de todo tipo. Un sistema desarrollado por Amazon que seleccionaba candidatos para un puesto de trabajo favorecía los currículums de hombres frente a los de mujeres. Lo hacía porque se entrenó con mayoría de currículums masculinos y no hubo forma de corregir esta desviación. Otro algoritmo, en este caso utilizado por el sistema sanitario en Estados Unidos, penalizaba a las personas negras frente a las blancas a igualdad de gravedad clínica, de forma que se asignaba un mayor riesgo a los blancos y, por tanto, se les daba prioridad en la atención médica.

Además, los sistemas autónomos lidian con problemas relacionados con la propiedad intelectual o con el uso de datos privados. Una fórmula para evitar estas deficiencias consiste en establecer autolimitaciones en el diseño del algoritmo. Ana Cuevas, profesora del área de Lógica y Filosofía de la Ciencia en la Universidad de Salamanca, defiende este enfoque proactivo: “No tenemos que esperar a que las cosas se produzcan para analizar los riesgos que pueden tener, sino partir del supuesto de que antes de crear un sistema de inteligencia artificial tenemos que pensar qué tipo de sistema quiero crear para evitar ciertos resultados indeseables”.

Ética en el lenguaje de las máquinas

La introducción de un corpus ético en las máquinas es un trabajo relativamente nuevo. La comunidad científica lo ha abordado sobre todo desde el punto de vista teórico, pero no es tan común bajar al barro para concretar valores en cifras y enseñanzas morales en ingeniería. En el grupo de investigación de Sánchez-López, WAI, de la Universitat de Barcelona, exploran este campo de forma experimental.

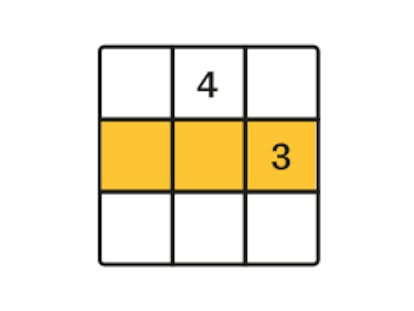

Estos investigadores vinculan los conceptos de valor y acción en el diseño de los sistemas. “Tenemos unas funciones matemáticas que nos dicen que para un determinado valor, una cierta acción de la máquina se considera positiva o negativa”, cuenta López-Sánchez. Así, en el ejemplo del coche autónomo, una conducción suave en una carretera con curvas se considerará positiva ante el valor de la seguridad. Aunque si se observa desde el prisma del valor de la amabilidad con los otros conductores, el vehículo podría decidir aumentar su velocidad si nota que entorpece el ritmo de otros automóviles.

En este caso concreto habría un conflicto entre valores, que se resolvería con una ponderación. Previamente, se establecen preferencias que indican qué valores prevalecen. Todo el conjunto comprende fórmulas entrelazadas, que además deben contener la variable de la norma. “Hay otra función que estipula que una norma promueve un valor”, apunta la investigadora. “Y tenemos también funciones que observan cómo una norma evalúa la acción y también cómo evalúa el valor dicha acción”. Es un complejo sistema en el que la retroalimentación es clave.

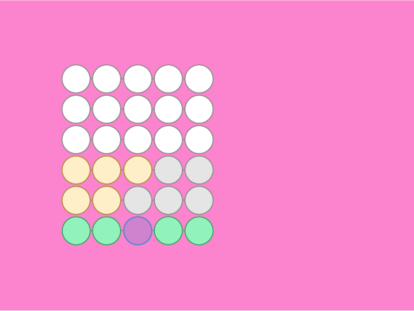

Cuando López-Sánchez habla de evaluar se refiere directamente al aprendizaje de las máquinas. Una de las formas que tienen de aprender es por refuerzo, como las personas, que actuamos bien porque se nos premia y evitamos hacerlo mal porque se nos castiga. En la inteligencia artificial también sirve este mecanismo.

“Las recompensas son números. Los premios se los damos con números positivos y los castigos se los damos con números negativos”, explica la investigadora del WAI. “Las máquinas intentan sacar cuantos más puntos mejor. Así que la máquina va a intentar portarse bien si le doy números positivos cuando hace las cosas bien. Y, si cuando se porta mal, la castigo y le quito puntos, intentará no hacerlo”. Como para instruir a los niños, se puntúa con fines educativos.

Pero existen muchas cuestiones por resolver. Para empezar, algo tan sencillo como decidir qué valores queremos introducir en las máquinas. “La ética se desarrolla de formas muy diferentes. En algunos casos tendremos que hacer cálculos utilitarios, de minimización de los riesgos o de los daños”, señala la profesora Cuevas. “Otras veces a lo mejor tenemos que usar códigos deontológicos más fuertes, como establecer que un sistema no puede mentir. Cada sistema necesita incorporar ciertos valores y para esto tiene que haber un acuerdo comunitario y social”.

En el laboratorio de López-Sánchez bucean en estudios sociológicos para encontrar valores comunes entre las personas y a través de diferentes culturas. Al mismo tiempo, toman como referencia documentos internacionales, como la Declaración Universal de Derechos Humanos de la ONU. Aunque habrá aspectos más difíciles de consensuar a nivel global. Así lo cree Cuevas: “Las limitaciones de las máquinas tendrán sus fronteras. La Unión Europea, por ejemplo, tiene su forma de hacer las cosas y Estados Unidos tiene otra”, enfatiza, en referencia al distinto abordaje regulatorio que se da a cada lado del Atlántico.

Puedes seguir a EL PAÍS Tecnología en Facebook y X o apuntarte aquí para recibir nuestra newsletter semanal.